Финансовые учреждения внедряют AI-автоматизацию для оценки кредитных рисков, обнаружения мошенничества и персонализации услуг. Однако регуляторы требуют прозрачности, справедливости и подотчётности алгоритмических решений. Согласно исследованию McKinsey (2024), 73% финансовых организаций сталкиваются с трудностями при балансировании инноваций и соответствия требованиям. Эта статья рассматривает продвинутые стратегии ответственного AI: непрерывный мониторинг смещений, интерпретируемость моделей, human-in-the-loop архитектуры и документирование решений для аудита. Мы фокусируемся на операционных паттернах, которые позволяют масштабировать AI-системы без компромисса с этическими стандартами и регуляторными рамками.

Ключевые выводы

- Внедрите конвейеры непрерывного мониторинга для отслеживания дрейфа данных и смещений модели в реальном времени

- Используйте методы интерпретируемости (SHAP, LIME) для документирования логики принятия решений в критичных сценариях

- Проектируйте human-in-the-loop контрольные точки для высокорисковых решений с чёткими эскалационными протоколами

- Создавайте аудиторские следы с версионированием моделей, входных данных и метаданных решений для регуляторной отчётности

Архитектура мониторинга смещений и дрейфа

Финансовые модели деградируют по мере изменения экономических условий и поведения клиентов. Продвинутые системы развёртывают конвейеры мониторинга, которые непрерывно сравнивают распределения входных признаков и выходных предсказаний с базовыми метриками. Типичный паттерн: агент-наблюдатель извлекает пакеты inference каждые 15 минут, вычисляет статистики (KL-дивергенция, Population Stability Index) и триггерит алерты при превышении порогов. Исследование Stanford HAI (2024) показало, что 41% финансовых моделей демонстрируют значимый дрейф в течение 90 дней. Workflow выглядит так: мониторинг → обнаружение аномалий → автоматическая пометка транзакций → эскалация к аналитику → переобучение или корректировка весов. Критично документировать каждое обнаружение дрейфа с временными метками, затронутыми сегментами и принятыми действиями. Это создаёт аудиторский след для регуляторов и позволяет ретроспективный анализ инцидентов. Системы также должны отслеживать демографические срезы для выявления непропорционального воздействия на защищённые группы.

Интерпретируемость и объяснение решений

Регуляторы требуют, чтобы финансовые учреждения объясняли автоматизированные решения, особенно при отказе в кредите или подозрении в мошенничестве. Методы post-hoc интерпретируемости, такие как SHAP (SHapley Additive exPlanations) и LIME (Local Interpretable Model-agnostic Explanations), генерируют ранжированные списки признаков, влияющих на конкретное предсказание. Операционный паттерн: модель генерирует предсказание → агент-объяснитель вычисляет SHAP-значения → система форматирует объяснение в человекочитаемый текст → логирование в базу объяснений. Согласно Anthropic (2024), гибридные архитектуры, сочетающие табличные модели с LLM-генерацией естественноязыковых объяснений, повышают удовлетворённость клиентов на 34%. Важно: объяснения должны быть фактически верными, а не просто правдоподобными. Внедрите валидационный слой, который проверяет согласованность между численными SHAP-значениями и текстовым описанием. Храните объяснения вместе с решениями для последующего аудита и разрешения споров.

Human-in-the-loop контрольные точки

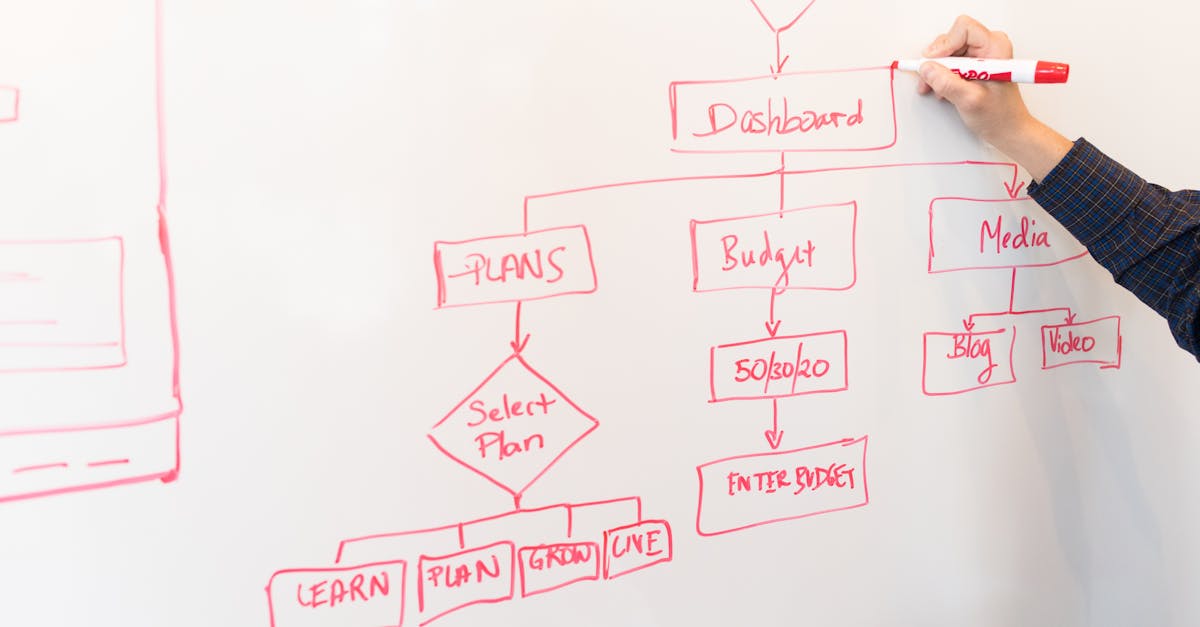

Полностью автоматизированные решения несут репутационные и юридические риски в финансовых сервисах. Продвинутые системы используют динамическую маршрутизацию: решения с высокой уверенностью (>95%) обрабатываются автоматически, средней уверенностью (70-95%) направляются на быструю проверку, низкой (<70%) эскалируются специалистам. OpenAI (2024) документировал, что такая стратегия снижает частоту ошибок на 82% при сохранении 91% автоматизации. Workflow: модель предсказывает + confidence score → агент-маршрутизатор применяет правила → задачи попадают в очереди по приоритету → эксперты принимают решение → обратная связь возвращается в систему обучения. Критичные элементы: чёткие SLA для каждой очереди, интерфейсы с контекстом (история клиента, объяснение модели, релевантные документы), механизмы обратной связи для корректировки порогов. Измеряйте не только точность, но и время принятия решения и когнитивную нагрузку на операторов.

Аудиторские следы и версионирование

Регуляторные проверки требуют полной реконструкции: какая модель, какие данные, какая логика привели к конкретному решению. Системы должны логировать: версию модели с хешем артефактов, входные признаки с временными метками, промежуточные выходы агентов, итоговое решение, человеческие переопределения. Используйте неизменяемые хранилища (append-only logs) для предотвращения ретроактивных изменений. Типичный стек: версионирование моделей в MLflow или аналоге, логирование признаков в временные ряды, решения в реляционную БД с foreign keys. McKinsey (2024) отмечает, что организации с комплексными аудиторскими системами сокращают время подготовки регуляторных отчётов на 68%. Автоматизируйте генерацию отчётов: агент-репортёр запрашивает данные за период → агрегирует метрики по демографическим группам → проверяет статистическую значимость различий → форматирует в шаблон регуляторного отчёта. Внедрите синтетические тесты для проверки полноты логирования: периодически прогоняйте тестовые транзакции и верифицируйте, что все элементы зафиксированы.

Тестирование справедливости и mitigation стратегии

Финансовые модели могут непреднамеренно дискриминировать защищённые группы через прокси-переменные или исторические смещения в данных. Продвинутые системы внедряют непрерывное тестирование справедливости: вычисление метрик (demographic parity, equalized odds, predictive parity) по демографическим срезам после каждого переобучения. Если обнаруживается несправедливость, применяются mitigation стратегии: reweighting обучающих примеров, adversarial debiasing, threshold optimization по группам. Stanford HAI (2024) показывает, что post-processing корректировка порогов решения снижает демографические различия на 47% с минимальной потерей общей точности. Операционный паттерн: обучение модели → тестирование справедливости → применение mitigation → повторное тестирование → документирование компромиссов. Важно: не существует универсального определения справедливости; выбор метрик зависит от бизнес-контекста и юрисдикции. Документируйте обоснование выбора и консультируйтесь с юридическими и этическими экспертами. Создайте дашборды для непрерывного мониторинга метрик справедливости в продакшене.

Заключение

Ответственный AI в финансовых сервисах требует системного подхода: непрерывный мониторинг дрейфа и смещений, интерпретируемость решений, human-in-the-loop контроль, комплексное логирование для аудита и проактивное тестирование справедливости. Эти стратегии не являются разовыми проектами — они требуют постоянной операционной дисциплины и инвестиций в инфраструктуру. Организации, которые встраивают ответственность в архитектуру AI-систем с самого начала, достигают более быстрого регуляторного одобрения, снижают репутационные риски и строят доверие клиентов. Начните с малого: выберите одну критичную модель, внедрите базовый мониторинг и объяснения, итеративно расширяйте практики. Балансируйте автоматизацию с надзором, инновации с соответствием требованиям, эффективность с этикой.